你的运行环境(版本号「点击帮助-关于-复制」):

TRAE

版本: 3.5.38

VSCode 版本: 1.107.1

提交: cce6734c02342b6c1520037c4eda59b354011bf4

日期: 2026-03-14T05:19:16.467Z

Electron: 39.2.7-release.1.26.3 (aha)

Node.js: 22.21.1

V8: 14.2.231.23-electron.0

OS: Windows_NT x64 10.0.19045

构建版本: 2.3.13960

设备ID: 458e63df7668bdf97d9013c97687ce261a89d7eddbc402febb1bed2f7fb5199a

Device Id: 7620441704184858113

问题描述(你遇到了什么问题?):

如何调用本地部署的大模型

复现步骤(如何才能重现这个 Bug/问题?):

1.使用Ollama部署qwen3:8b大模型(window10笔记本)

2.使用TRAE-Ollama-Bridge-main进行中转

3.正常添加,厂商选择OpenAI,模型选自定义,最终添加成功

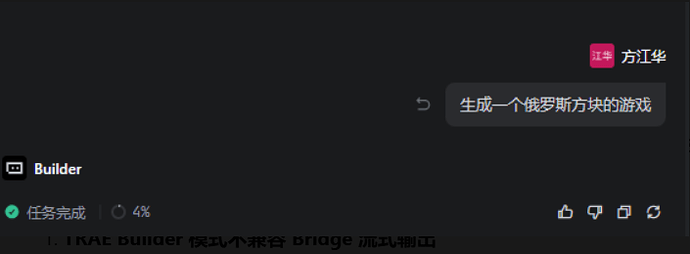

4.执行时选择该自定义模型,Trae最终无任何报错,仅显示下图状态

报错信息或截图(如有):

请在此处粘贴截图或日志代码