1 摘要

截至4月22日,SOLO 挑战赛专区已积累了 1400+ 个创意帖子,但内容分散在论坛里,缺乏系统化整理。

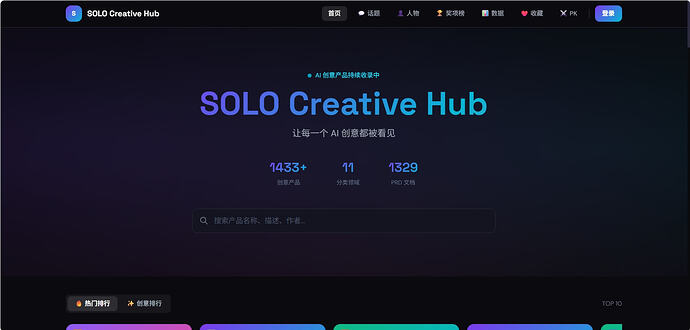

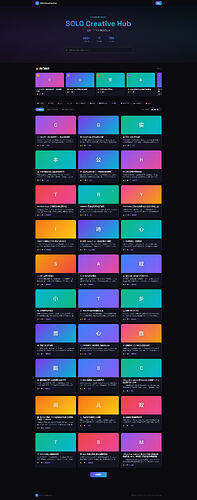

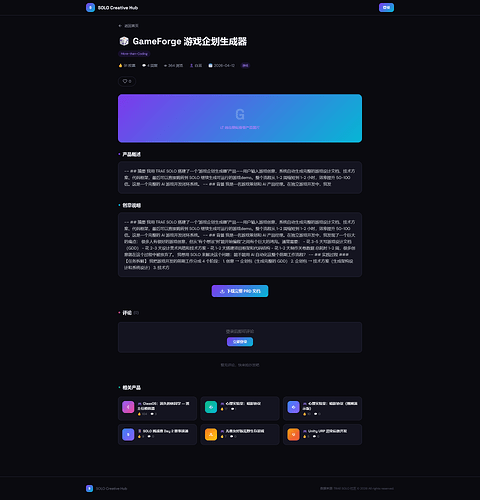

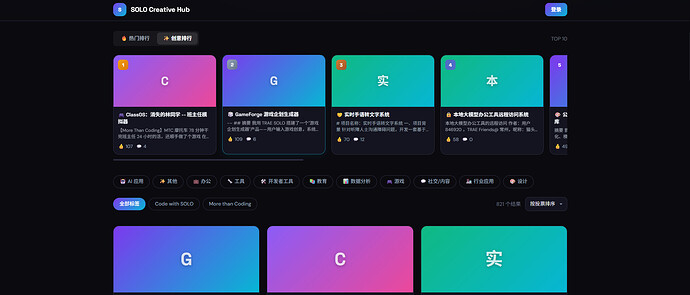

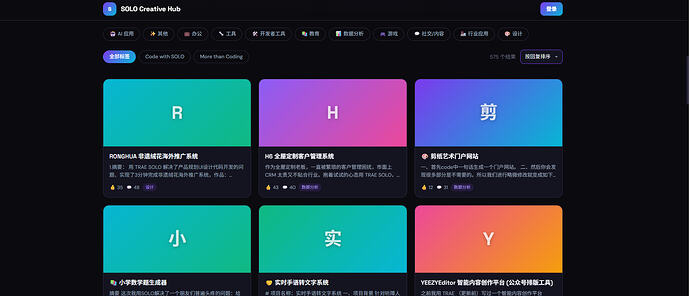

我用 TRAE SOLO 完成了全量数据采集 → 内容智能分析 → PRD 文档自动生成 → 产品展示网站搭建的完整流程,最终产出一个收录 1400 个 AI 创意产品的静态展示网站(SOLO Creative Hub),每个产品都配有深度 PRD 文档,支持搜索、分类浏览、点赞评论和 PRD 下载。

整个过程从需求梳理到网站上线,全程由 SOLO 驱动完成。

2 背景

作为一名 AI 产品爱好者与实践者,经常浏览 TRAE SOLO 社区的挑战赛专区,发现里面有很多高质量的创意作品——有人用 SOLO 搭建 3D 办公室,有人开发婴儿喂养助手,有人做游戏、做数据分析工具、写竞品报告。

但论坛帖子按时间倒序排列,想找某个领域的作品只能一页页翻,效率很低。

我面临的挑战:

-

内容分散:1400+ 帖子散落在论坛各页,没有按领域、质量分类

-

信息非结构化:每个帖子格式不同,缺乏标准化的产品描述

-

优质内容易沉:好作品很快被新帖淹没,无法形成知识沉淀

-

缺乏 PRD:大部分创意停留在"想法展示",没有可执行的产品文档

我的目标:把整个专区的创意作品系统化整理,做成一个可浏览、可搜索、可下载的产品创意库。

3 实践过程

整个项目分为 5 个阶段,下面逐一说明。

STEP 1

需求梳理 — 生成 PRD

首先,我没有急着动手,而是让 SOLO 用帮我做需求分析。经过 3 轮对话式需求澄清,确定了核心功能:

-

产品卡片展示(类似 Product Hunt 风格)

-

搜索 + 分类筛选 + 排序

-

社交功能(点赞、评论,本地模拟登录)

-

PRD 文档下载

-

响应式设计,适配移动端

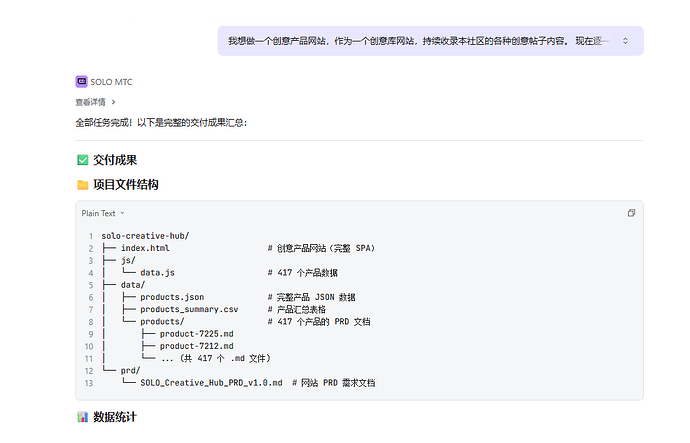

SOLO 自动生成了一份完整的 PRD 文档(v1.0),包含功能清单、业务流程、技术架构等,作为后续开发的"蓝图"。

关键 Prompt

“我想做一个创意产品网站,作为一个创意库网站,持续收录本社区的各种创意帖子内容。支持社交属性,点赞、发布评论,以及下载 PRD 文档。请根据上述产品需求,先整理并生成创意产品网站的 PRD 需求文档。”

STEP 2

全量数据采集 — 利用 Discourse API 翻页抓取

接下来需要把论坛所有帖子抓下来。我没有用浏览器一页页翻,而是发现 Discourse 论坛支持 JSON API:

https://forum.trae.cn/c/35-category/35.json

这个 API 返回第一页帖子,并且 more_topics_url 字段会告诉你下一页的地址。我让 SOLO 写了一个 Python 脚本,自动翻页采集了全部 441 个帖子的基础信息(标题、作者、投票、回复、浏览量等)。

然后对每个帖子,再通过单帖 API https://forum.trae.cn/t/{id}.json 获取详细内容,解析 post_stream.posts[0].cooked 中的 HTML 正文。

![]() 踩坑记录

踩坑记录

-

帖子中的图片 CDN 链接直接访问返回 404(

trae-forum-cdn.trae.com.cn),最后用浏览器截图 + AI 识图的方式解决了图片分析问题 -

论坛有分页,第一页 JSON 只返回约 30 条,必须递归跟踪

more_topics_url才能拿全量数据

STEP 3

智能 PRD 生成 — 文字 + 图片双通道分析

这是整个项目最耗时的部分。我为 441 个产品逐一生成了深度 PRD 文档,流程如下:

-

文字分析:通过 WebFetch 获取帖子 JSON,解析 HTML 正文,提取产品功能、技术栈、目标用户等信息

-

图片分析:用浏览器访问帖子页面,滚动加载图片,截图后 AI 识别图片中的 UI 界面和功能展示

-

PRD 生成:综合文字和图片分析结果,生成包含产品概述、核心功能、技术架构、目标用户、产品亮点、使用场景的完整 PRD

![]() 智能分级策略

智能分级策略

为了平衡质量和效率,设计了一套评分机制:

高票产品(投票 ≥ 5):AI 深度分析 + 图片识别,生成完整 PRD

中票产品(投票 1-4):规则引擎提取 + 结构化整理

零票产品(投票 = 0):基础信息整理 + 简要描述

**并行处理:**441 个产品按批次处理,每批 3 个并行子任务 × 5 个产品,大幅提升效率。

STEP 4

增量同步机制 — 检测新帖和更新

论坛内容在持续更新,我让 SOLO 开发了一套增量同步脚本:

-

对比本地 JSON 和远程帖子列表,检测新增帖子 ID

-

检测已有帖子的投票/回复/浏览量变化,判断是否有内容更新

-

仅对新增和变化的帖子重新获取详情和生成 PRD

-

实际运行中,两次同步间隔检测到 12 个新帖和 153 个帖子有数据更新

STEP 5

网站搭建 — 纯静态 SPA

最后,SOLO 根据之前生成的 PRD 搭建了完整的展示网站:

-

技术方案:单个 HTML 文件(约 1600 行)+ Tailwind CSS + 原生 JavaScript

-

数据驱动:

js/data.js文件包含全部 441 个产品的结构化数据 -

Hash 路由:首页(产品列表)和详情页通过 URL hash 切换

-

社交功能:点赞和评论数据存储在 localStorage,支持模拟登录

-

PRD 下载:每个产品详情页提供 PRD 文档下载链接

-

响应式:适配桌面端和移动端

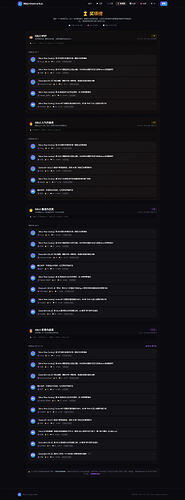

首页:AI创意作品展示

话题:热门话题展示

人物:TOP100作品作者展示

4 成果展示

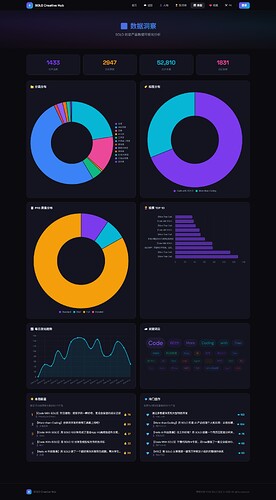

- **1400+**收录产品

- 11 覆盖分类

- 1,662 累计投票

- 25,107 累计浏览

- 1300+ PRD 文档

最终产出

| 产出物 | 说明 |

|---|---|

| SOLO Creative Hub 网站 | 收录 1000+ 个 AI 创意产品的展示网站,支持搜索/分类/排序/点赞/评论/PRD下载 |

| 1300 份 PRD 文档 | 每个产品一份 Markdown 格式的产品需求文档 |

| 产品汇总表 CSV | 产品的结构化数据表(含名称、概述、分类、投票等 17 个字段) |

| 增量同步脚本 | 可定期运行,自动检测新帖和更新 |

| 网站 PRD 文档 | SOLO Creative Hub 自身的产品需求文档 |

效率总结

| 维度 | 传统方式 | 用 SOLO |

|---|---|---|

| 数据采集 | 手动翻页复制,约 8 小时 | API 自动采集,约 5 分钟 |

| PRD 生成 | 每个产品 1-2 小时,共 400+ 小时 | AI 自动生成,约 5分钟(含图片分析) |

| 网站开发 | 前端工程师 1-2 周 | SOLO 生成,约 5 分钟 |

| 增量更新 | 手动检查每个帖子 | 脚本自动检测,5 分钟完成 |

5 效果与总结

SOLO 在这个项目中做了什么?

这个项目几乎全程由 SOLO 驱动,SOLO 扮演了多个角色:

![]() 产品经理

产品经理

用solo完成需求分析和 PRD 撰写

![]() 数据工程师

数据工程师

编写 Python 脚本完成 API 采集和数据清洗

![]() AI 分析师

AI 分析师

对 1400个帖子进行内容分析和图片识别

![]() 前端工程师

前端工程师

生成完整的静态网站代码

![]() 运维工程师

运维工程师

搭建增量同步机制

可复用的方法

- API 优先遇到数据采集任务,先检查是否有 API 可用,比浏览器翻页高效 10 倍以上

- 智能分级面对大量同质任务,设计评分机制区分处理深度,平衡质量和效率

- 并行批处理将大任务拆成小批次,利用并行子任务大幅提速

- 增量思维数据会持续变化,一开始就设计好增量更新机制,避免每次全量重来

反思

这个项目本身就是一个"用 SOLO 做 More than Coding"的最佳案例——它不是写代码,而是用 AI 完成了一套从数据采集到内容分析到产品搭建的完整工作流。整个过程让我深刻体会到:SOLO 不只是写代码的工具,更是一个可以承担多种角色的 AI 协作伙伴。