GLM-5.1:跑分、规格、计费要点 信息速读

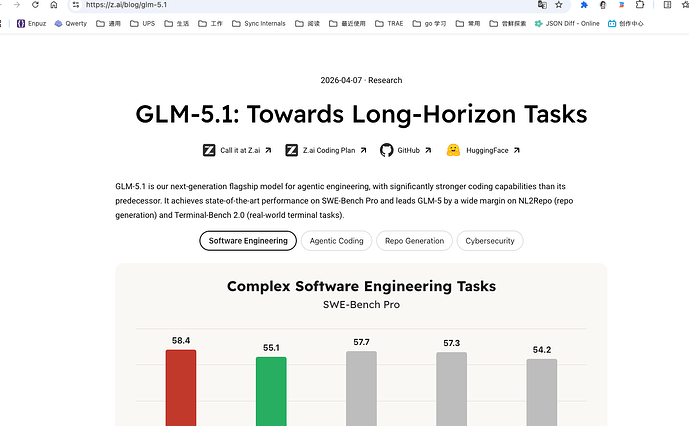

4 月 7 日,Z.ai 开源 GLM-5.1 全量权重,MIT 协议,Hugging Face 可直接下载。它引发关注的核心点有两个:其一是官方披露的 SWE-bench Pro=58.4;其二是模型评估的重点从单轮生成转向了长程任务(long-horizon)的持续迭代能力。

-

Hugging Face 模型页:https://huggingface.co/zai-org/GLM-5.1

长程迭代叙事

原文:

“But the most meaningful leap goes beyond first-pass performance. Previous models—including GLM-5—tend to exhaust their repertoire early: they apply familiar techniques for quick initial gains, then plateau. Giving them more time doesn’t help. GLM-5.1, by contrast, is built to stay effective on agentic tasks over much longer horizons.”

但最有意义的飞跃远不止首次通过性能。以往的模型——包括 GLM-5——往往会在早期用尽已有的方法,快速获得初步提升后便进入平台期。再给它们更多时间也无济于事。相比之下,GLM-5.1 的设计使其能够在更长的时间范围内在代理任务中保持有效。

官方用三个场景做了演示:向量库优化(600+ 轮迭代,QPS 从基线提升到 21.5k)、KernelBench Level 3(50 题 GPU kernel 优化,几何平均加速 3.6×)、以及 8 小时构建 Linux 桌面式 Web 应用。

来源:https://huggingface.co/zai-org/GLM-5.1、https://z.ai/blog/glm-5.1

规格

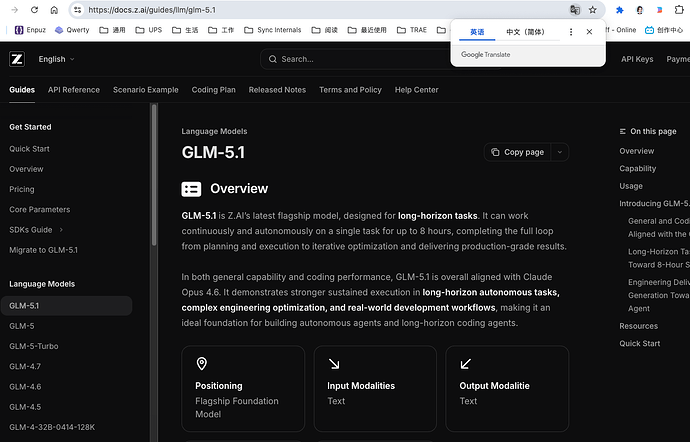

官方开发文档写明 GLM-5.1 支持 200K 上下文、最大输出 128K tokens;这类规格更适合把仓库、日志、评测输出都塞进一次长任务里跑闭环。

来源:GLM-5.1 - Overview - Z.AI DEVELOPER DOCUMENT

计费要点

成本上,最确定且最重要的是"倍率规则"而非某个单价。官方明确:

-

峰时(北京时间 14:00–18:00):按 3× 扣费/扣配额

-

非峰时:按 2× 扣费/扣配额

-

限时规则:到 4 月底非峰时按 1×

对长程任务来说,这个规则会直接决定你跑同一个项目的实际成本波动。

来源:https://z.ai/blog/glm-5.1、https://docs.z.ai/guides/overview/pricing

与 Claude 对比

Claude 的 API 官方定价:

-

Sonnet 4.6:$3/MTok 输入、$15/MTok 输出、$0.30/MTok 缓存命中

-

Opus 4.6:$5/MTok 输入、$25/MTok 输出、$0.50/MTok 缓存命中

GLM-5.1 基础单价(1×):输入 $1.4/MTok、输出 $4.4/MTok、缓存命中 $0.26/MTok。峰时按 3×、非峰时按 2× 扣费,4 月底前非峰时按 1×。

来源:https://docs.z.ai/guides/overview/pricing、https://platform.claude.com/docs/en/about-claude/pricing

结论

原文:

"Across all three settings, the key variable is not runtime alone but whether additional runtime remains useful. GLM-5.1 extends that productive horizon meaningfully beyond GLM-5, while the remaining gap on tasks like KernelBench shows that long-horizon optimization is still an open frontier."

在所有三个场景中,关键变量不在于运行时间本身,而在于额外的时间是否仍然有用。GLM-5.1 将这一有效时间范围显著超出了 GLM-5,而 KernelBench 等任务上仍存在的差距表明,长程优化仍是一个开放的前沿方向。

来源:https://z.ai/blog/glm-5.1、https://huggingface.co/zai-org/GLM-5.1

Sources(官方):