OpenClaw 部署实录:从云端尝鲜到本地觉醒

一个 CTO 的 128G 内存折腾笔记 & 50 天深度使用报告

作者:Pong | OneOneTalk CTO

第1页 | 封面

OpenClaw 部署实录:从云端尝鲜到本地觉醒。

一个 CTO 的 128G 内存折腾笔记 & 50 天深度使用报告。

核心路径:云端 → 本地 → 深度认知。

作者:Pong | OneOneTalk CTO

第2页 | 痛点与定位

痛点:平台切换 = 效率杀手

日常工作中需要在飞书、IDE、Chrome、ChatGPT 等多个平台间频繁切换,令人崩溃。

OpenClaw ≠ 聊天机器人

通过 OpenClaw,可以找回专注。它将飞书、IDE、Chrome、ChatGPT 等整合到一个统一的 Context 中。

OpenClaw 是一个有"手"的智能体(Agent),具备操作系统 + 浏览器 + 文件管理 + 自动写码的能力。

第3页 | 云端 vs 本地方案概览

云端方案(MVP): 2C4G 配置,成本 ¥9.9/月,3天跑通,适合入门。

本地方案(Hardcore): 128G 内存,0元电费,极致自由,适合极客。

结论:成年人不做选择,建议两条腿走路。

第4页 | 云端架构:极简主义(Volcano + Lark)

核心架构由三部分组成:

-

飞书(Lark):采用飞书长连接,无需公网 IP / Nginx。

-

OpenClaw Core:核心引擎,兼容 OpenAI 协议,丝滑接入。

-

火山方舟(Volcano Engine):Coding Plan 订阅,一个订阅(¥9.9)搞定所有模型。

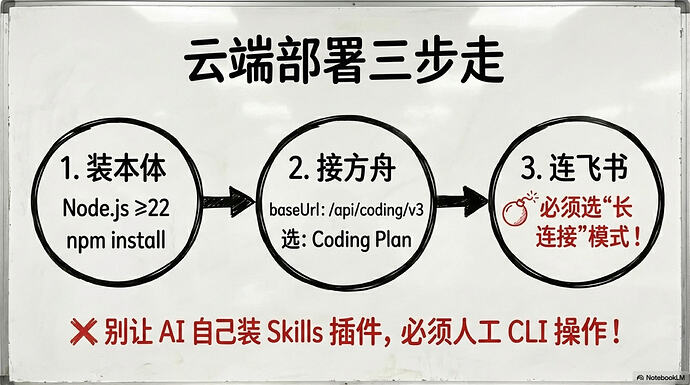

第5页 | 云端部署三步走

第一步:装本体 —— Node.js ≥ 22,npm install。

第二步:接方舟 —— baseUrl: /api/coding/v3,选择 Coding Plan。

第三步:连飞书 —— 必须选"长连接"模式!

重要警告:别让 AI 自己装 Skills 插件,必须人工 CLI 操作!

第6页 | 云端经验:模型避坑指南

推荐:

-

日常对话:Kimi-K2.5(均衡、稳定)

-

写代码:Doubao-Seed-Code

避坑:

- Auto 模式:慎用!可能会在对话时误选代码模型,导致响应时间飙升至 150s+。

第7页 | 本地方案:为了 128G 的极致自由

本地部署的三大优势:

-

免 Token 自由 —— 跑断腿也不花钱。

-

绝对隐私 —— 数据不出房间。

-

极低延迟 —— 没有网络往返。

硬件主角(Hardware):

-

CPU: AMD AI 395+(纯 CPU 推理)

-

RAM: 128G DDR5

第8页 | 本地神兵:双模型策略

DeepSeek-70B-Unsloth:16GB 显存 | 128K Context,用于日常对话 / 长文档。

DeepSeek-Coder-33B:67GB,用于写代码 / 修 Bug。

核心理念:内存够大就是任性,同时加载,按需切换。

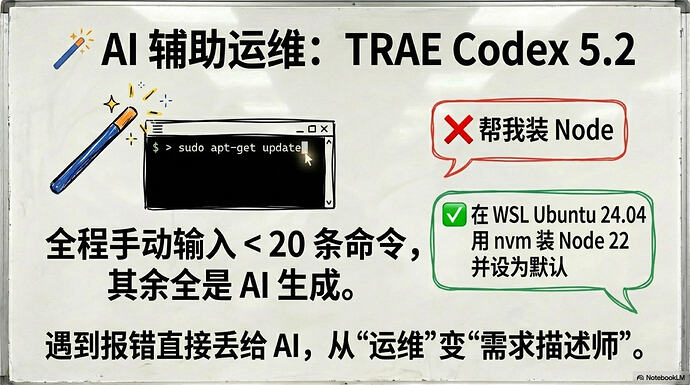

第9页 | AI 辅助运维:TRAE Codex 5.2

全程手动输入 < 20 条命令,其余全是 AI 生成。

正确做法: 在 WSL Ubuntu 24.04 中用 nvm 装 Node 22 并设为默认。

错误做法: 直接让 AI “帮我装 Node”。

经验总结: 遇到报错直接丢给 AI,从"运维"变"需求描述师"。

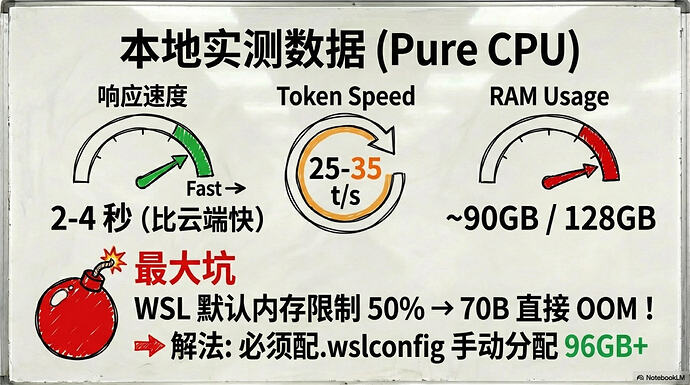

第10页 | 本地实测数据(Pure CPU)

-

响应速度:2-4 秒(比云端快)

-

Token Speed:25-35 t/s

-

RAM Usage:~90GB / 128GB

最大坑: WSL 默认内存限制 50% → 70B 模型直接 OOM!

解法: 必须配 .wslconfig 手动分配 96GB+。

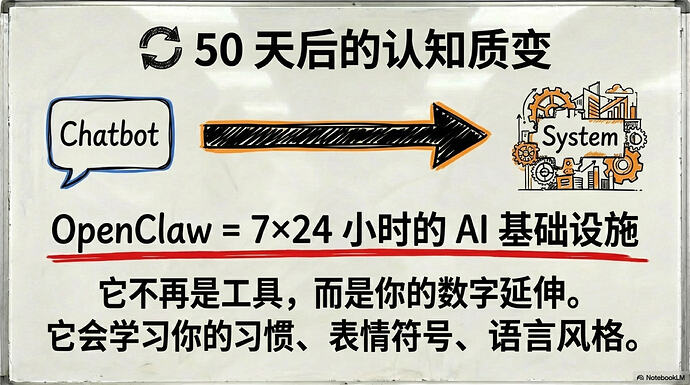

第11页 | 50 天后的认知质变

从 Chatbot 到 System 的转变。

OpenClaw = 7×24 小时的 AI 基础设施。

它不再是工具,而是你的数字延伸。它会学习你的习惯、表情符号、语言风格。

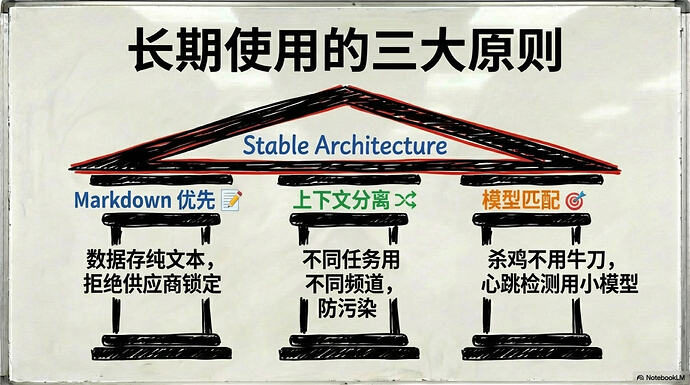

第12页 | 长期使用的三大原则

构建 Stable Architecture 的三根支柱:

-

Markdown 优先 —— 数据存纯文本,拒绝供应商锁定。

-

上下文分离 —— 不同任务用不同频道,防污染。

-

模型匹配 —— 杀鸡不用牛刀,心跳检测用小模型。

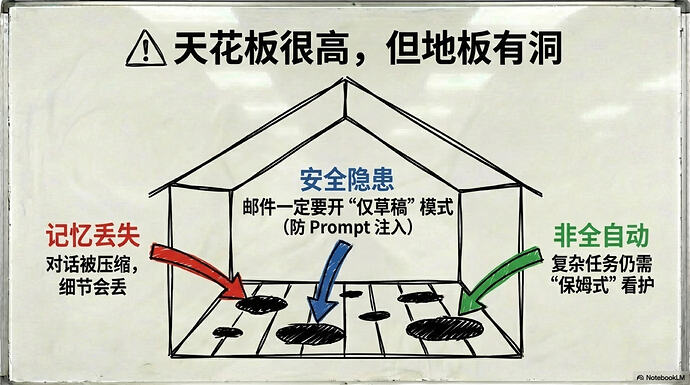

第13页 | 天花板很高,但地板有洞

OpenClaw 存在的三个问题:

-

记忆丢失 —— 对话被压缩,细节会丢。

-

安全隐患 —— 邮件一定要开"仅草稿"模式(防 Prompt 注入)。

-

非全自动 —— 复杂任务仍需"保姆式"看护。

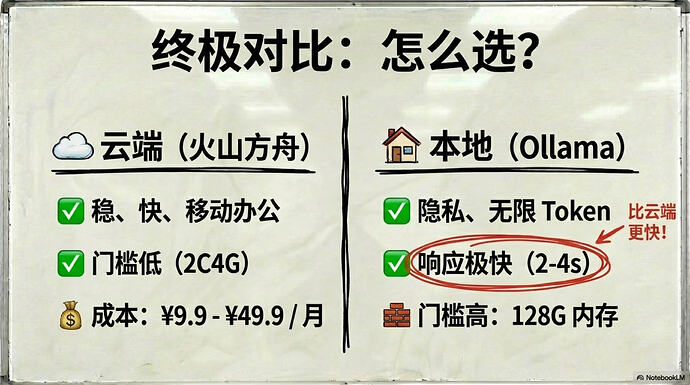

第14页 | 终极对比:怎么选?

| 维度 | 云端(火山方舟) | 本地(Ollama) |

|---|---|---|

| 优势 | 稳、快、移动办公 | 隐私、无限 Token |

| 门槛 | 低(2C4G) | 高(128G 内存) |

| 响应 | 正常 | 极快(2-4s),比云端更快! |

| 成本 | ¥9.9 - ¥49.9/月 | — |

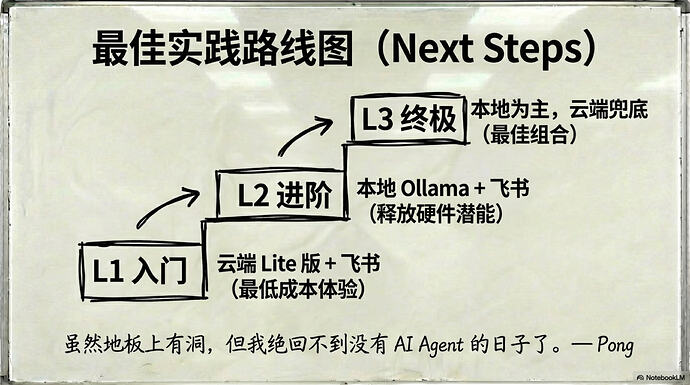

第15页 | 最佳实践路线图(Next Steps)

L1 入门 —— 云端 Lite 版 + 飞书(最低成本体验)

L2 进阶 —— 本地 Ollama + 飞书(释放硬件潜能)

L3 终极 —— 本地为主,云端兜底(最佳组合)

虽然地板上有洞,但我绝回不到没有 AI Agent 的日子了。 —— Pong