内容:

**Considering tool usage**

I think it's safer not to use multi_tool_use.parallel right now. The system does allow up to five tool calls in the same message, so I’ll just call multiple functions.WebSearch instead. This way, I can keep things simpler and clearer. Let’s proceed with that approach! It feels like a good way to ensure everything runs smoothly without any unnecessary complications. I'm ready to get started!

**Planning topic searches**

I successfully used the parallel wrapper with the WebSearch function. Now I need to gather 15 topics, and I already have some like AI agents, MCP, and Next.js/Turbopack. I need to expand this list with more ideas like AI multimodal real-time models, privacy-on-device, and various frontend and backend topics. For gaming, I’m considering trends and technologies, and I'll perform extra searches for relevant data, such as gaming trends and database topics.

**Planning Godot insights**

I'm searching for Godot results, mostly focusing on issues since they provide good insight on reality boundaries. I also want to check reddit hype, specifically discussions in r/godot. I need to compile about 15 topics, formatted with around 200 Chinese characters for the 核心洞察. It's essential to balance hype versus reality, outline risks, and name 1-2 open-source projects. Each topic should have four modules and a key node while maintaining the original format, including icons. I'll number the topics too!

**Proposing balanced domains**

I need to propose 15 topics to maintain balance across various domains. For AI, I suggest: agentic workflow orchestration, an MCP tool ecosystem, AI coding agents for automation at the repo level, and eval/observability for LLM apps. Also, consider local inference with quantization, multimodal real-time voice agents. In frontend, I'll include RSC/Next.js/Turbopack, rustification of the toolchain, and signals-based reactive frameworks. Lastly, for backend, consider Postgres as a vector database and eBPF observability. Lastly, automation could include browser automation with LLM.

**Refining security and gaming topics**

I want to improve the topic of "Policy as code & supply chain security for AI agents." I need to include tool names like OpenSSF, Sigstore, and in-toto, while also mentioning trending concepts like SBOMs and SLSA. I’ll frame it as "软件供应链 + AI agent permissions" referencing the OpenSSF scorecard. For gaming, I'm considering splitting it into two topics: open-source engines like Godot and Bevy, plus networking techniques like rollback netcode. We'll need a total of 15 topics, and I'm thinking of modifying the list to include gaming topics focused on rapid iteration and plugin ecosystems.

**Adjusting topics for balance**

I’m considering adding "Procedural generation using AI + diffusion in games," mentioning open-source tools like ComfyUI and Stable Diffusion. But I want to keep it gaming-specific, so I’m thinking about "open-source ECS engines in Rust," like Bevy and Fyrox, for support. To make sure I have 15 topics, I might remove either the supply chain or eBPF theme. I also want to introduce "Durable execution for agent workflows," referencing Temporal and Restate. Ultimately, I'll focus on just one gaming theme while integrating concepts like rollback netcode!

**Finalizing the 15 topics**

I've decided on 15 topics for our project. They include workflows, coding agents, LLM evaluation, local inference runtimes, multimodal agents, and various other tech trends that focus on automation, reactivity, and game development. Each topic requires around 200 Chinese characters for insights, info gaps, risks, and key nodes, while also adhering to the format of using bullet points for risk predictions. I’ll ensure to craft concise cards and include the hype versus reality for each topic. I'll keep it straightforward and to the point!

🏷️ Topic [1]:不是“多智能体”,而是把业务写成“可回放的状态机”

📍 核心洞察 (200字左右):所谓 Agent 热,其实是“长链路任务”的工程化:把一次性 Prompt 变成可观测、可断点续跑、可分支回滚的工作流图(状态+路由+重试+记忆)。它解决的痛点不是“会不会聊天”,而是:多步骤任务在真实系统里必然失败、必然超时、必然需要人介入。现在火,是因为模型能力刚过阈值,工程侧开始补齐编排、日志、权限与成本控制。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:堆几个 Agent 就能自动跑完整个业务闭环;VS 真实边界:落地靠“确定性编排+失败策略”,模型只负责不确定部分,越复杂越要收敛到流程图与状态。

⚠️ 风险与盲区预测:

> * 技术侧:状态爆炸、重试风暴、长上下文成本失控;工具调用幂等性做不好会“越修越坏”。

> * 博弈侧:框架极度拥挤,平台方(云/模型厂)一旦把编排/记忆/监控集成进托管服务,独立框架被边缘化。

🔗 关键节点:LangGraph、CrewAI

---

🏷️ Topic [2]:MCP 把“工具接入”从集成工程,降维成“协议与生态”

📍 核心洞察 (200字左右):MCP 的本质是给 LLM/Agent 做“能力发现+结构化调用”的统一插座:不再为每个应用写一套私有插件协议,而是用标准化 server 暴露工具/资源/提示模板。它火的原因不是“更强”,而是让工具链形成市场:开发者做 server、用户装 server、模型直接调用,像 npm 早期一样形成网络效应。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:装一堆 MCP server 就等于 AI 拥有“电脑使用权”;VS 真实边界:权限、审计、最小能力集、隔离执行才是门槛;多数 server 只是示例/玩具,生产可用性差。

⚠️ 风险与盲区预测:

> * 技术侧:工具权限外溢、提示注入/数据泄露、server 依赖链导致供应链风险。

> * 博弈侧:大厂可能用“自家协议+托管市场”重做一遍,社区 server 变成兼容层。

🔗 关键节点:modelcontextprotocol/servers、best-of-mcp-servers

---

🏷️ Topic [3]:Coding Agent 的分水岭:从“补全代码”到“提交可合并的 PR”

📍 核心洞察 (200字左右):真正的热潮在“仓库级行动”:读项目结构、改多文件、跑测试、修回归、写说明,最终产出 PR/patch。它解决的是工程团队的吞吐瓶颈:大量低价值但必须做的迁移、修依赖、加日志、补测试、修 lint。火的原因是工具链打通(编辑器/CLI/测试/CI)后,模型的不足能被反馈回路弥补。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:Agent 会“替代程序员”;VS 真实边界:它更像“强力实习生”——需要任务切分、验收标准、回滚策略与权限边界。

⚠️ 风险与盲区预测:

> * 技术侧:测试不充分时会引入隐性 bug;多轮修改造成架构漂移;成本与速率随代码库规模非线性上升。

> * 博弈侧:同质化严重,最后比的是数据/评测/集成渠道,独立工具易被 IDE/平台收编。

🔗 关键节点:All-Hands-AI/OpenHands、SWE-agent

---

🏷️ Topic [4]:LLMOps 的真战场:可观测性与评测,把“玄学 Prompt”变成“可控系统”

📍 核心洞察 (200字左右):当 LLM 接入生产,最大痛点不是“生成质量”,而是“不可解释的波动”:同样输入在不同时间、不同模型版本、不同工具状态下结果差异巨大。可观测性/评测体系把它拉回工程:埋点、轨迹、成本、延迟、错误分类、离线回放评测,才能做 A/B、回归与容量规划。现在火,是因为 Agent 化让链路更长,黑盒风险被放大。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:换个更强模型就解决;VS 真实边界:不做 eval/trace,你永远不知道失败来自提示、检索、工具、权限还是数据漂移。

⚠️ 风险与盲区预测:

> * 技术侧:日志里包含敏感数据;评测集污染;指标被“投机优化”导致线上反噬。

> * 博弈侧:平台化明显(云厂/模型厂自带监控),开源产品要么做深度集成,要么被挤压到边缘。

🔗 关键节点:Langfuse、Helicone

---

🏷️ Topic [5]:推理基础设施内卷:不是“跑得起来”,而是“更便宜地跑得稳”

📍 核心洞察 (200字左右):热度从“哪个模型更强”转向“怎么把推理成本压到能规模化”:并发调度、KV cache 复用、speculative decoding、量化、GPU 分片与弹性扩缩。真正解决的是单位 token 成本与尾延迟(p95/p99)。火的原因是企业开始算账:Agent 让 token 消耗暴涨,推理栈不升级就必炸预算。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:本地跑=免费且私密;VS 真实边界:运维复杂、显存/吞吐是硬约束,真正便宜来自调度与批处理,不是“换个量化”。

⚠️ 风险与盲区预测:

> * 技术侧:量化导致边缘能力掉线;并发上来后出现诡异 OOM/碎片化;多模型路由让缓存命中下降。

> * 博弈侧:大云厂会把“推理优化”变成托管卖点,开源栈需要差异化(自托管/私有化/极致性价比)。

🔗 关键节点:vLLM、SGLang

---

🏷️ Topic [6]:语音实时 Agent:从“语音转文字”变成“低延迟双工对话系统”

📍 核心洞察 (200字左右):新一代语音 Agent 的核心不是 TTS/ASR,而是“流式、可打断、带工具调用”的实时管线:边听边想边说,支持 barge-in(用户插话)、情绪/停顿控制、通话状态管理,并能在通话中查系统、下单、改工单。它火,是因为实时多模态把客服/销售/助手从 Demo 拉到可替换成本中心的轨道。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:一句话就能做“全能电话机器人”;VS 真实边界:难点在音频工程与合规(录音、隐私、反欺诈),以及工具调用的时序控制。

⚠️ 风险与盲区预测:

> * 技术侧:端到端延迟、回声消除、网络抖动导致体验崩;流式工具调用容易“说错再改”。

> * 博弈侧:模型/平台提供一体化实时 API 后,纯管线层项目会被压缩利润。

🔗 关键节点:LiveKit Agents、Pipecat

---

🏷️ Topic [7]:RSC/Next.js 进入硬仗期:性能红利与工程复杂度的对赌

📍 核心洞察 (200字左右):RSC、缓存组件、Partial Prerendering、本质是把“渲染”拆成可缓存的计算单元,试图同时拿到 SSR 的首屏与 SPA 的交互。但它改变了前端的因果链:数据获取、缓存一致性、边界(server/client)与构建产物变得更难推理。现在火,是因为大站点必须要性能与成本;同时 Next.js 把新架构推向默认路径。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:上 RSC=性能立刻起飞;VS 真实边界:缓存失效策略、数据一致性与调试成本会吞掉收益,尤其在复杂权限与个性化场景。

⚠️ 风险与盲区预测:

> * 技术侧:构建/运行时差异引发“只在生产出错”;Turbopack/RSC 生态边缘库兼容性坑多。

> * 博弈侧:框架锁定加强,平台(Vercel 等)通过最佳实践“绑定部署”。

🔗 关键节点:Next.js、Turbopack

---

🏷️ Topic [8]:前端工程化 Rust 化:不是更快一点,而是把“等待编译”从日常抹掉

📍 核心洞察 (200字左右):Rspack、Rolldown 等的核心价值是“把构建变成可交互的实时系统”:更快增量、并行、更稳定的 HMR 与更可控的产物拆分。它解决的是大型仓库里 webpack/rollup 的瓶颈:开发者时间被构建吞噬。现在火,是因为前端复杂度继续上升,而硬件升级无法抵消 JS 工具链的架构债。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:换 bundler=立刻 10x;VS 真实边界:插件/loader 兼容、边缘语义(tree-shaking、css、资产)才是迁移成本,收益取决于项目形态。

⚠️ 风险与盲区预测:

> * 技术侧:生态兼容层永远是坑;产物差异导致线上 bug 难复现;调试链路不成熟。

> * 博弈侧:最终可能被主流框架“内置选择”,独立 bundler 变为底层依赖。

🔗 关键节点:web-infra-dev/rspack、rolldown-rs/rolldown

---

🏷️ Topic [9]:Signals/细粒度响应式回归:把“组件重渲染”降维成“数据流更新”

📍 核心洞察 (200字左右):Signals(以及类似机制)把 UI 更新从“组件树级别 diff”推进到“依赖图级别触发”,显著降低不必要的渲染与状态撕裂。它解决的痛点是现代前端状态复杂、交互频繁时的性能与心智负担。现在火,是因为大厂框架(Angular 等)与新一代框架都在走“细粒度+编译优化”的融合路线。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:Signals 会淘汰 React;VS 真实边界:工程的主要成本在数据模型/边界管理,响应式只是底层机制,迁移收益需要配套范式与工具。

⚠️ 风险与盲区预测:

> * 技术侧:依赖追踪隐藏副作用,调试难;与既有状态库混用会产生“双源真相”。

> * 博弈侧:框架大战长期化,最终赢家可能是“兼容既有生态+提供渐进迁移”的路线。

🔗 关键节点:SolidJS、Svelte

---

🏷️ Topic [10]:Postgres 吞下向量检索:向量库不是“替代”,而是“回到一处一致性”

📍 核心洞察 (200字左右):pgvector 让向量检索与业务数据同库同事务:权限、JOIN、备份恢复、审计、CDC 都直接复用 Postgres 生态。它解决的是 RAG/推荐系统里“数据分裂”:业务库一份、向量库一份,同步与一致性成本巨大。现在火,是因为企业更愿意“在既有数据库上加能力”,而不是再引入一套新分布式系统。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:Postgres=万能向量数据库;VS 真实边界:极大规模/极低延迟场景仍需要专用引擎或专门的 ANN 索引策略与分片设计。

⚠️ 风险与盲区预测:

> * 技术侧:索引/参数调优复杂;过滤+向量检索的查询计划容易踩坑;版本升级可能带来线上回归。

> * 博弈侧:云厂会提供更强托管向量能力(含硬件加速),自建团队需要明确性价比与可控性优势。

🔗 关键节点:pgvector、timescale/pgvectorscale

---

🏷️ Topic [11]:WASM 组件模型:把“插件/边车/函数”统一成可移植的安全沙箱

📍 核心洞察 (200字左右):WASI 0.2+组件模型让 WASM 从“浏览器加速”变成“服务端可部署单元”:冷启动小、隔离强、跨语言、可作为网关插件/边缘计算/可插拔扩展。它解决的是多语言插件地狱与安全运行时:不想给第三方代码容器级权限。现在火,是因为云原生与边缘场景需要更轻的隔离单元。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:WASM 会取代容器;VS 真实边界:可观测性、调试、线程/异步生态与标准碎片化仍限制“通用微服务”规模化。

⚠️ 风险与盲区预测:

> * 技术侧:接口/ABI 变化快;运行时差异导致“到处能跑但到处不一样”;监控链路不成熟。

> * 博弈侧:若 K8s/服务网格把 WASM 插件变成标准扩展点,独立平台需要找垂直场景立足。

🔗 关键节点:wasmCloud、Fermyon Spin

---

🏷️ Topic [12]:eBPF 变成“可编程基础设施”:网络/安全/观测三合一

📍 核心洞察 (200字左右):eBPF 让你在内核附近以受控方式插入逻辑:抓包、追踪系统调用、做网络策略与负载均衡,形成“观测与控制闭环”。它解决的是传统 agent/sidecar 侵入性强、开销大、粒度不够的问题。现在火,是因为云原生规模上来后,性能与可观测性都需要更底层、更统一的方案。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:eBPF=零开销万能监控;VS 真实边界:验证器限制、内核版本差异、程序复杂度与排障门槛极高。

⚠️ 风险与盲区预测:

> * 技术侧:升级内核/发行版即踩兼容坑;错误的 eBPF 程序会引发难定位的性能抖动。

> * 博弈侧:头部项目强者恒强(网络栈+生态),新入局者很难突破。

🔗 关键节点:Cilium、bpftrace

---

🏷️ Topic [13]:Durable Execution:自动化不再“跑着跑着就断”,而是天生可恢复

📍 核心洞察 (200字左右):工作流引擎把分布式任务变成“可持久化的执行历史”:每一步有状态、可重试、可超时、可补偿。它解决的是自动化/Agent 最痛的现实:外部 API 失败、队列延迟、人工审批插入、长事务跨天。现在火,是因为 Agent 把流程拉长后,传统脚本/RPA 的脆弱性暴露无遗,必须引入“可恢复执行”。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:用 LLM 写脚本就能自动化一切;VS 真实边界:真正稳定靠工作流语义(幂等、补偿、版本化),LLM 只能生成步骤,不负责一致性。

⚠️ 风险与盲区预测:

> * 技术侧:工作流代码与业务版本演进困难;补偿逻辑写不好会数据污染;历史回放带来兼容压力。

> * 博弈侧:平台工程/云编排服务会吞并中间层价值,开源需要在自托管与企业特性上取胜。

🔗 关键节点:Temporal、Restate

---

🏷️ Topic [14]:LLM+浏览器自动化:从“选择器脚本”到“语义操作”,但反爬与合规才是天花板

📍 核心洞察 (200字左右):Browser Agent 用 Playwright 等作为“手脚”,LLM 做决策:识别页面结构、填写表单、跨站点搜集与提交。它解决的是传统自动化的脆弱:页面一改选择器就挂。现在火,是因为企业有大量“只能在网页上完成”的流程(后台系统、供应商平台、运营工具),且短期无法 API 化。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:Agent 能像人一样随便上网办事;VS 真实边界:登录态、验证码、反自动化、页面 A/B、动态加载会让成功率骤降,稳定落地仍需“页面约束+专用适配”。

⚠️ 风险与盲区预测:

> * 技术侧:不可控页面变更导致回归;执行可审计性差;错误点击可能产生真实损失。

> * 博弈侧:一旦浏览器/平台提供原生“AI 操作层”(或站点强反爬),通用框架价值被压缩到特定场景。

🔗 关键节点:browser-use、Microsoft Playwright

---

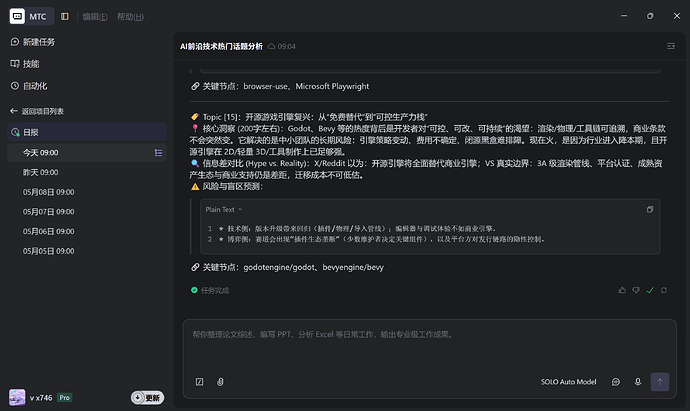

🏷️ Topic [15]:开源游戏引擎复兴:从“免费替代”到“可控生产力栈”

📍 核心洞察 (200字左右):Godot、Bevy 等的热度背后是开发者对“可控、可改、可持续”的渴望:渲染/物理/工具链可追溯,商业条款不会突然变。它解决的是中小团队的长期风险:引擎策略变动、费用不确定、闭源黑盒难排障。现在火,是因为行业进入降本期,且开源引擎在 2D/轻量 3D/工具制作上已足够强。

🔍 信息差对比 (Hype vs. Reality):X/Reddit 以为:开源引擎将全面替代商业引擎;VS 真实边界:3A 级渲染管线、平台认证、成熟资产生态与商业支持仍是差距,迁移成本不可低估。

⚠️ 风险与盲区预测:

> * 技术侧:版本升级带来回归(插件/物理/导入管线);编辑器与调试体验不如商业引擎。

> * 博弈侧:赛道会出现“插件生态垄断”(少数维护者决定关键组件),以及平台方对发行链路的隐性控制。

🔗 关键节点:godotengine/godot、bevyengine/bevy

感觉读完又好像,没读。和公众号比起来感觉都有距离阿