一句话:每个孩子的画都值得被看见,每个声音都值得被回应。

一、作品名称

KidSpark —— 童心闪耀,点燃孩子的创作火花

二、作品定位(科技至善赛道)

核心主张:

自闭症儿童难以用语言表达情绪,聋哑儿童渴望被听见。但他们都会画。

KidSpark 让涂鸦“活过来”——孩子画什么,AI 就让什么动起来,并配上温柔的故事。

这不是特效,这是他们与世界沟通的新语言。

三、解决了什么问题

3.1 真实痛点

| 人群 | 痛点 | 现状 |

|------|------|------|

| 自闭症儿童 | 难以用语言表达情绪,社交障碍 | 现有工具偏“训练”,枯燥、缺乏情感连接 |

| 聋哑儿童 | 渴望表达但受限于手语/文字 | 缺乏“从创作出发”的表达工具 |

| 普通家庭儿童 | 创作热情难以持续,作品散落各处 | 涂鸦画完就被遗忘,没有“创作→反馈”闭环 |

| 家长/治疗师 | 想了解孩子的内心世界,没有桥梁 | 只能观察行为,难以进入孩子的“视角” |

3.2 我的亲身感受

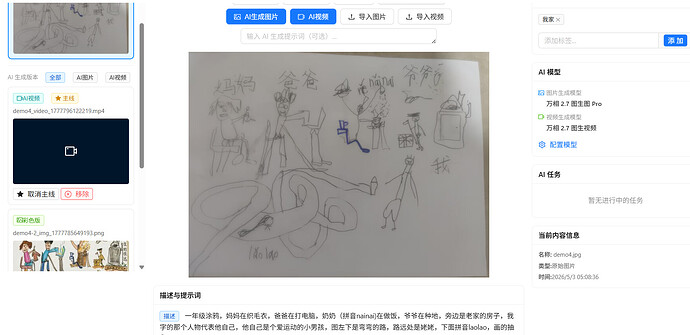

当面对家里小朋友,一段时间不知道他想表达什么,从3-4岁乖巧听话到上一年级以来,我们总要忍不住要发火,当他抽象的涂鸦我们根本看不懂他想表达什么。

当他一次次专注画画,但并不是课堂上的动物和花草,甚至一度怀疑自己孩子也有了“自闭”倾向。

当我从APP扫描图案解读涂鸦时,看到孩子心里的表达,才意识到我们大人忽略了孩子的表达,总是按成人的视角去看孩子的画,抽象的看不懂。

这就是 KidSpark 的起点。

四、功能特点

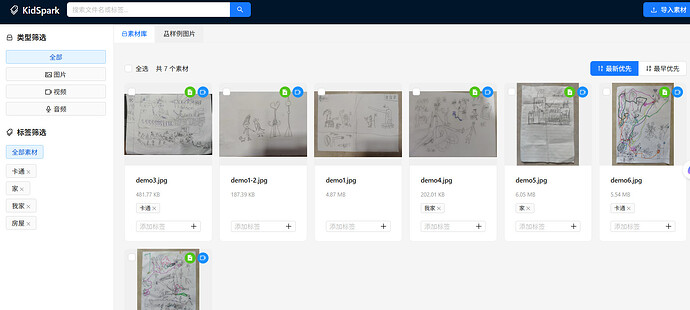

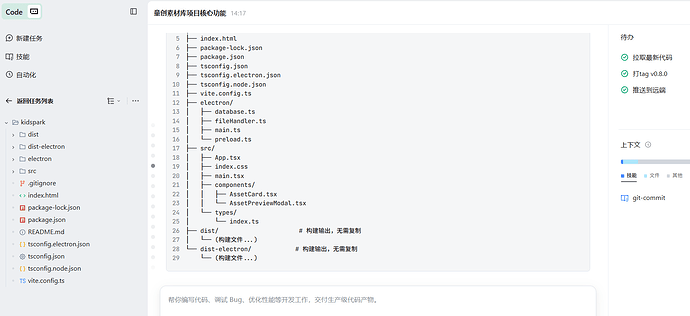

素材管理

-

素材导入:支持拖拽上传单个文件、多个文件或整个文件夹

-

多格式支持:图片 (jpg/png/heic/webp)、视频 (mp4/mov/avi)、音频 (mp3/m4a/wav)

-

自动分类:按年/月/日组织导入的素材

-

缩略图生成:自动为图片和视频生成缩略图

-

重复检测:按文件名自动检测重复导入

-

批量删除:支持多选批量删除,同时清理物理文件

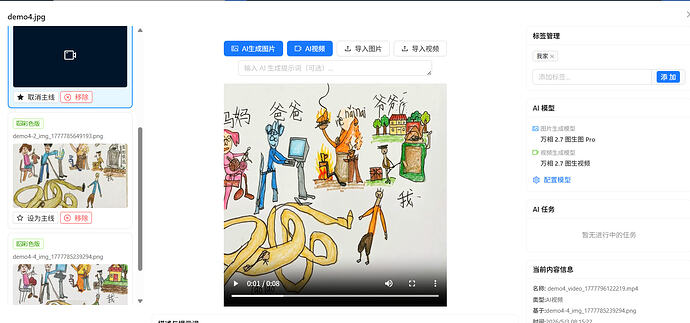

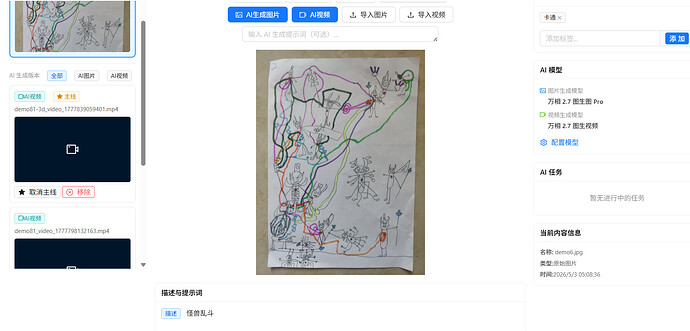

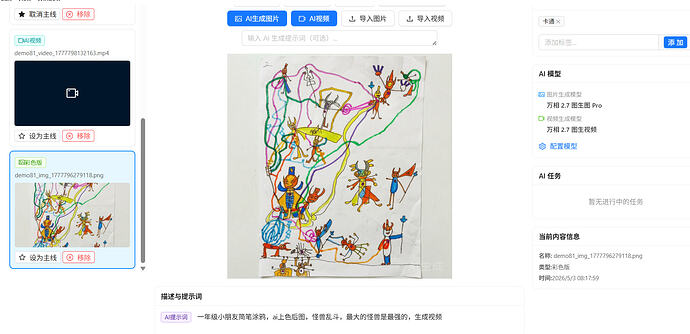

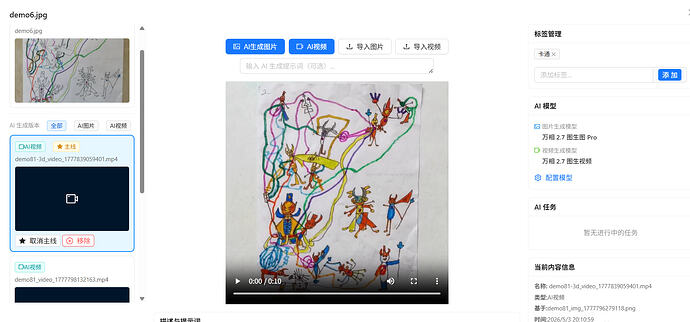

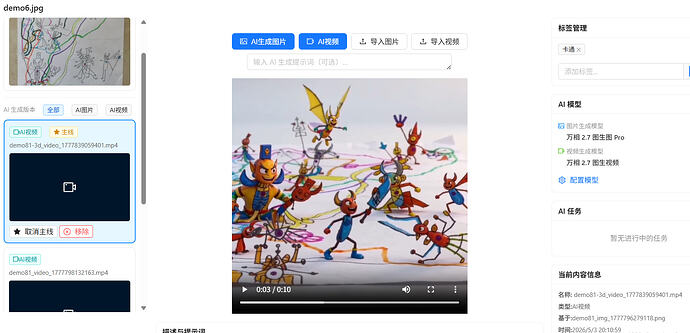

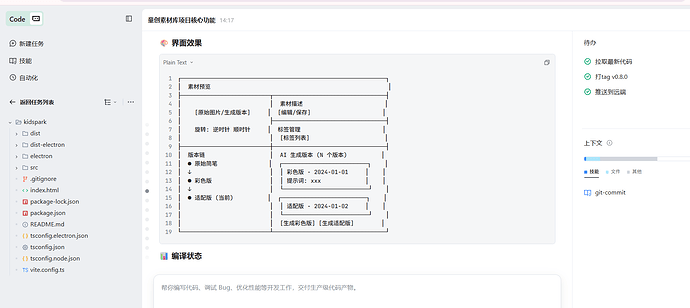

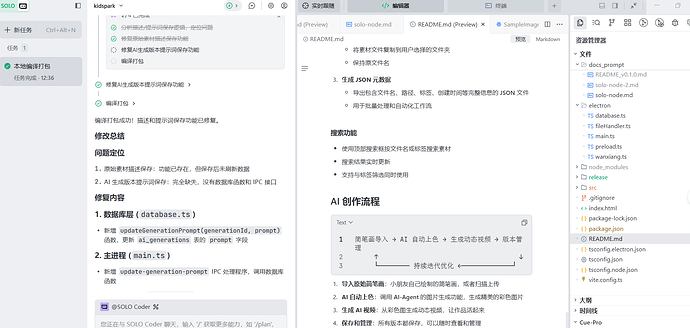

AI 创作

-

AI 内容理解:识别画了什么、什么颜色、可能是什么情绪

-

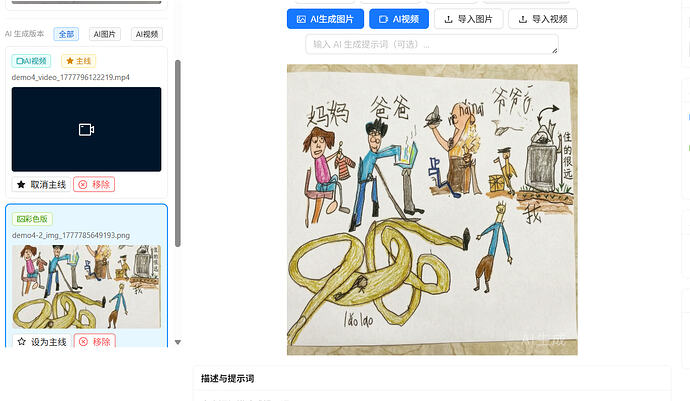

AI 自动上色:将简笔画转为精美的彩色图片

-

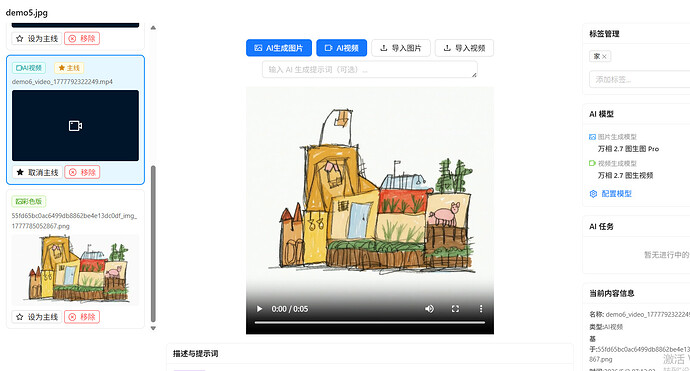

AI 生成动画:让涂鸦中的元素动起来(3-5 秒循环动画)

-

AI 配故事:根据画面生成 50-100 字的小故事

-

版本链管理:支持主线串联和衍生分支,形成完整的创作版本树

-

情绪标注:AI 分析色彩/线条,标记可能的情绪状态

标签与筛选

-

标签系统:为素材添加多个标签,支持多标签同时筛选

-

类型筛选:按图片/视频/音频快速筛选

-

搜索功能:按文件名或标签搜索素材

导出功能

-

复制文件路径:一键复制选中文件路径到剪贴板,可直接粘贴到 ComfyUI/Stable Diffusion

-

导出到文件夹:将素材复制到用户选择的文件夹

-

生成 JSON 元数据:导出包含完整信息的 JSON 文件

样例展示

- 内置简笔画 → AI 彩色图 → CSS 动画视频的完整样例演示

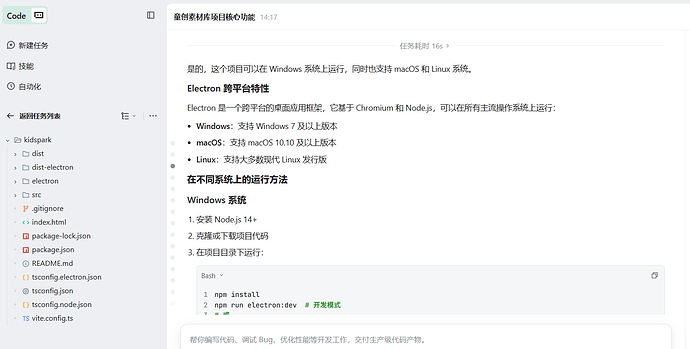

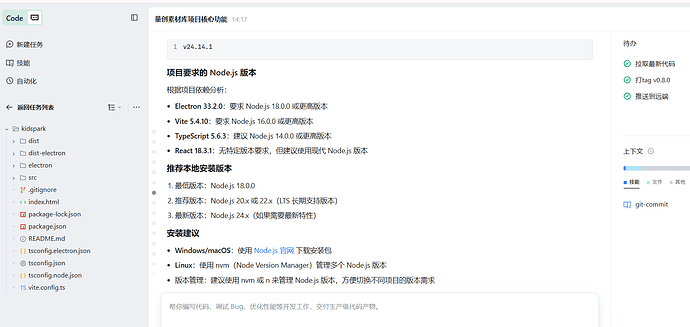

五、技术架构

5.1 技术栈

| 层级 | 技术 | 用途 |

|------|------|------|

| 桌面框架 | Electron | 跨平台桌面应用 |

| 前端框架 | React 18 + TypeScript | 界面与类型安全 |

| UI 组件 | Ant Design 5 | 组件库 |

| 本地数据库 | SQLite (better-sqlite3) | 素材索引与标签 |

| 图像处理 | Sharp | 缩略图生成 |

| 视频处理 | FFmpeg | 视频缩略图 |

| 构建工具 | Vite + electron-builder | 开发与打包 |

5.2 核心流程

孩子涂鸦 → AI 理解内容+情绪 → 自动上色 → 生成动画 → 配故事

备注:本次参赛以跑通流程为主,非遵循通用的从涂鸦到视频的完整流程,以跑通流程为主。

5.3 核心设计:本地优先

-

所有数据存储在用户本地:

~/Documents/KidSpark/ -

数据库、原始文件、缩略图、AI 生成物全部本地保存

-

不上传云端,保障家庭隐私(数据永远在用户的硬盘上)

5.4 技术亮点

| 亮点 | 说明 |

|------|------|

| 本地优先设计 | 所有素材存在用户硬盘,不上传云端,保障隐私 |

| 跨平台支持 | Windows + macOS + linux,一套代码多个平台 |

| AI 能力可插拔 | 支持 DeepSeek/阿里/kimi等模型,未来可迁移 |

| 零学习成本 | 拖拽上传即可,孩子也能独立操作 |

六、作品创新点

6.1 核心创新:从“训练”到“表达”

| 对比维度 | 现有特殊儿童工具 | KidSpark |

|----------|-----------------|----------|

| 定位 | 训练、矫正、评估 | 表达、创作、连接 |

| 交互方式 | 点选、配对、重复 | 涂鸦、看动画、听故事 |

| 情感维度 | 弱 | 强(AI 识别情绪+回应情绪) |

| 用户角色 | 被动接受 | 主动创作 |

6.2 技术创新

-

多模态理解 + 生成闭环:不是“识别涂鸦是什么”,而是“理解之后让涂鸦活过来”

-

本地优先 + AI:平衡隐私保护和 AI 能力,家长放心使用

-

版本链管理:每次 AI 生成都保留为独立版本,支持“设为主线”串联创作路径

-

低技术门槛:拖拽上传即可,家长/治疗师无需学习

七、社会价值

7.1 直接价值

| 受益群体 | 价值 |

|----------|------|

| 自闭症儿童 | 非语言表达的桥梁,获得“被听见”的体验 |

| 聋哑儿童 | 用视觉语言(涂鸦+动画)讲述自己的故事 |

| 普通儿童 | 建立“创作→反馈”正向循环,持续激发兴趣 |

| 家长 | 理解孩子的内心世界,找到连接点 |

| 治疗师 | 辅助观察工具,了解孩子情绪状态 |

7.2 社会意义

科技至善的本质,不是做“更酷的技术”,而是做“让弱势群体被看见”的技术。

KidSpark 希望成为一盏小灯,每个孩子能表达自己,理解世界,也照亮那些不善于用语言表达的孩子。

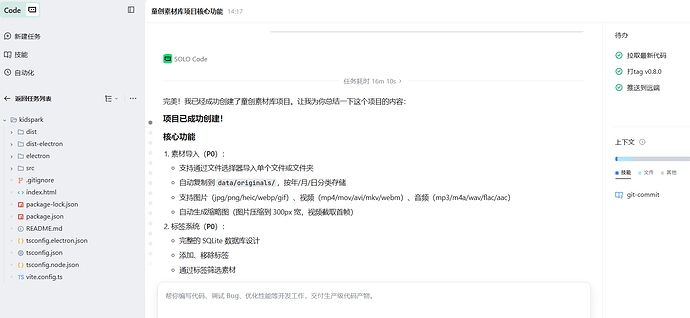

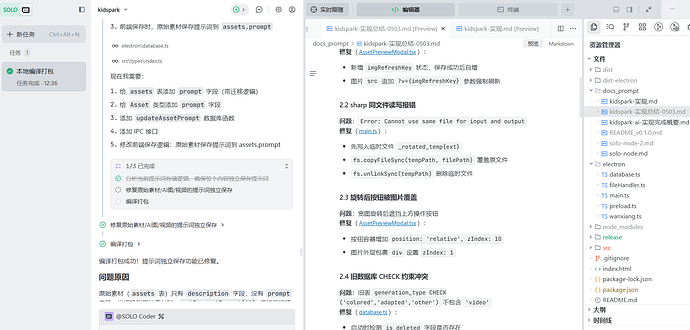

八、技术实现说明

8.1 开发过程

-

开发工具:Trae Solo(80% 代码由 AI 生成)

-

核心代码:Electron 主进程 + React 渲染进程 + SQLite 数据库

-

AI 集成:这个能力可以自行二次开发和集成,本文先通过离线导入串联的方式,组织管理。

接入api能力的模型(阿里万相),在本软件之间生成(进行中) -

动画生成:CSS 动画 + SVG 绘图(演示级),可扩展为 Replicate API

8.2 使用 Trae Solo 的体验

| 维度 | 体验 |

|------|------|

| 效率提升 | 3 天完成 MVP 原型(传统开发需要 2 周) |

| 调试辅助 | 出错时 AI 能快速定位问题并提出修复方案 |

| 学习成本 | 减少查文档时间,专注产品逻辑 |

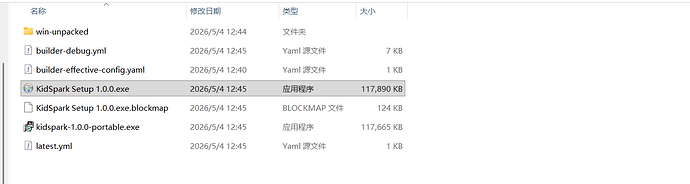

九、本地编译、下载与体验

| 平台 | 获取方式 |

|------|----------|

| Windows 安装包 | release/KidSpark Setup 1.0.0.exe |

| Windows 便携版 | release/kidspark-1.0.0-portable.exe |

(会尽快提供可执行包的网盘)

| 源码 | GitHub:https://github.com/uncleask/kidspark |

打包产物位于

release/目录下。比赛演示视频中展示的功能为完整可运行版本。

十、未来规划

-

支持批量导出,方便备份保存

-

增加涂鸦解析,能够让大人看懂原始图

-

语言、视频的原始素材的管理和关联

十一、参赛感受

这次参加 Trae Solo,最深的感受是:独立开发者不再是一个人在战斗。

AI 帮我生成了 80% 的代码,我只需要关注 20% 的产品和用户价值。

当我的孩子看到自己的涂鸦被点亮色彩,生成视频,他兴奋和感动,父母也更能理解孩子。

希望它能真正帮助到那些需要被听见的孩子。